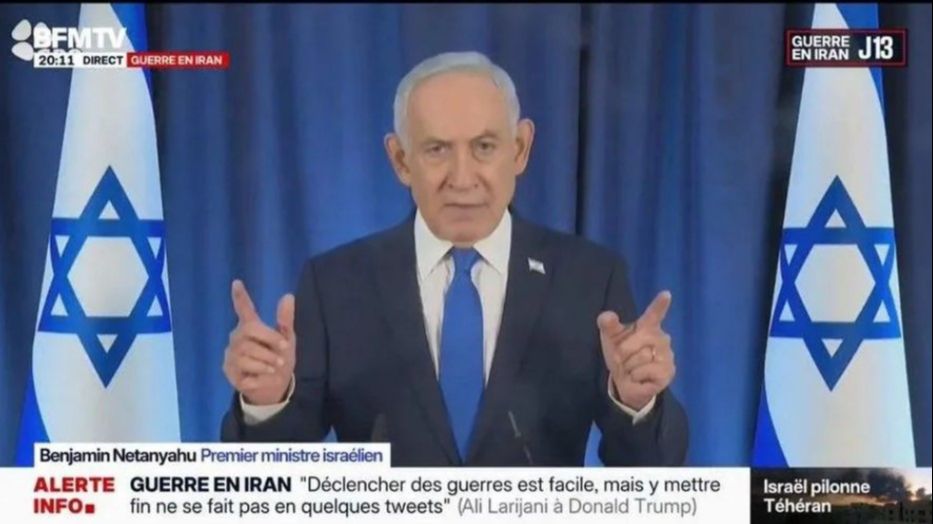

Već neko vrijeme se špekuliše o tome da se izraelski premijer Benjamin Netanjahu ne pojavljuje u javnosti, a za sve snimke i fotografije koji se objavuju na zvaničnim nalozima na društvenim mrežama se govori da su rezultat vještačke inteligencije.Hadžib Salkić, stalni sudski vještak iz oblasti kriminalistike, mobilnih tehnologija, videa i fotografije Federalnog ministarstva pravde BiH i stručnjak za sajber sigurnost, za „Avaz“ je nakon analize kazao je da sadržaji koji prikazuju Benjamina Netanjahua prolaze kroz sve sofisticiranije oblike digitalne manipulacije, pri čemu se u javnosti pojavljuju video i foto materijali sa visokim stepenom vizuelne uvjerljivosti, ali sa jasnim forenzičkim indikatorima neautentičnosti.

– Kod video sadržaja dominantan obrazac manipulacije temelji se na „deepfake“ arhitekturama, posebno modelima za „face reenactment“ i „facial identity mapping“. U takvim videima lice Netanjahua je generisano ili rekonstruisano putem neuronskih mreža koje koriste referentne „datasetove“ njegovih javnih nastupa. Međutim, analiza frame-by-frame pokazuje tipične „temporal inconsistencies“, odnosno varijacije između uzastopnih frejmova koje nisu karakteristične za prirodni video signal – objasnio je Salkić.

On dalje navodi da jedan od najsigurnijih znakova da je video manipulisan jeste neusklađenost između zvuka i pokreta usana. Iako moderni sistemi pokušavaju precizno uskladiti govor i mimiku, često se može primijetiti da izgovorene riječi ne odgovaraju tačno pokretima usana, posebno kod bržeg govora ili složenijih riječi. Analiza pokreta lica također ponekad pokazuje neprirodne promjene u području obraza i vilice koje ne odgovaraju stvarnim pokretima ljudskog lica.

– Zvuk u takvim videima često je generisan pomoću sistema za sintetički govor. Analize pokazuju da takav glas ima ujednačen ton i nedostaje mu prirodna varijacija, kao i sitne pauze i zvukovi disanja koji su tipični za stvarni ljudski govor. Upravo ti detalji mogu otkriti da je riječ o vještački generisanom sadržaju – istakao je Salkić.

Kod fotografija manipulacije se najčešće prave pomoću AI alata za generisanje slika, poput Stable Diffusion ili Midjourney, kazao je Salkić, dodajući da akve slike često imaju određene nepravilnosti koje mogu otkriti da nisu stvarne.OSINT dimenzija analize dodatno potvrđuje sumnju na manipulaciju. Većina spornih materijala nije potvrđena kroz kredibilne izvore kao što su Reuters, BBC ili CNN, niti postoji višestruka verifikacija iz nezavisnih izvora. Distribucija ovih sadržaja često slijedi obrazac koordiniranih kampanja, gdje se isti materijal simultano pojavljuje na više platformi putem niskokredibilnih naloga – kazao je.

Kombinacija ovih faktora omogućava visoko pouzdanu procjenu da značajan dio takvih sadržaja nije autentičan, već rezultat sofisticiranih generativnih i manipulativnih tehnika koje se koriste u savremenom digitalnom i informacionom ratovanju, zaključio je Salkić.